ホーム

0フォロー

30フォロワー

METACITY CONFERENCE 2019 ガイド

青木 竜太コンセプトデザイナー / 社会彫刻家

【全セッション完全記事化!】

昨年開催された「METACITY CONFERENCE 2019」の全11セッションを完全記事化!7月1日から順次配信中。

METACITY CONFERENCE 2019では、アーティスト・研究者・デザイナー・技術者・企業・行政関係者といった方々を招聘することで、さまざまな角度から「都市のありうる形」を議論していきました。ここで検討された都市に対するさまざまな切り口は、既存の都市が混迷を極める昨今の状況でこそ強い示唆を持っているはずです。

現在、世界はパンデミックによって物理的に分断され、付随するインフォデミックによって情報的に分断され、さらにBlack Lives Matterに関連した抗議活動によって人種的な分断さえもがあらためて可視化されています。そんな分断の時代から見えてくる「ありうる都市」の形とは?この記事シリーズが、そんな問いを考える一助になれば幸いです。

人工生命(ALife)とは何か──AIや生物学との違い、「都市デザイン」や「組織」への応用

青木 竜太コンセプトデザイナー / 社会彫刻家

数学を用いて普遍的な生命現象の原理を探求しようとする「人工生命」という研究分野がある。言わば「生命のOS」を探求しようとしている分野だ。

AI時代(人と機械が共に考える時代)において、ALifeの技術は現時点のAIが足りない部分を補完するだけではなく、人と機械の新しいインタラクションや体験をデザインする上で重要なものになっていくだろう。

未来のUXデザイナーは、おそらくALife技術が必須、少なくとも知識は求められてくる気がしている。

コンピュータの歴史と密接に関わりがあるにも関わらず、テクノロジー業界でもあまり知られていない。しかもWEB上にもあまり情報がないので、歴史や社会応用例を出しながら解説記事を書いてみた。

何の画像か特定できる「AI」システム、ネットで公開中

青木 竜太コンセプトデザイナー / 社会彫刻家

AIシステム(ライブラリ)が続々と出てくる。

記事の文末に、「ImageIdentify」へのリンクはあるが、分かりにくいのでこちらにも掲載しておく。

https://www.imageidentify.com/

試しに家の電球の写真を入れてみたら、"device"と返ってきた。間違ってはいない(笑)

下記のリンクを見ると"Wolfram Language"であれば、事前に分かっている情報を与えてあげると対象の絞り込みができる(より正確な回答が得られる)ようだ。

https://www.imageidentify.com/about/how-it-works

ちなみにユーザー独自の学習データを保持することはできるのだろうか?アプリ毎に特定の何か(顔や物など)を覚えこませたいニーズはあると思う。

リクルート、中国人旅行者に日本の飲食店の情報提供、中国最大の決済アプリ「Alipay」と連携で

青木 竜太コンセプトデザイナー / 社会彫刻家

外国人観光客の食に関連するサービスは、まだまだ考えられそう。

イスラム教徒の友人が日本に来た時、彼らが食べられるレストランを探すのが大変だった記憶がある。

インドネシアやマレーシアから来るイスラム教徒の観光客も増えていると聞く。

日本に住む私ですら中々探せなかったので、日本語も読めない彼らは困っている可能性が高い。

イスラム教徒が食べられるレストラン特集とクーポンも意外とニーズがありそう。アプリとまでいかなくても、空港にそのような冊子が置いてあるだけで喜ばれそうな気がする。ターゲットもある程度絞られているので広告枠も設定しやすいかもしれない。

イスラム教徒だけでなく、ベジタリアンやアレルギーの方々など、思想的、体質的に食べられない人達も多い。日本に来た途端にある意味、食的マイノリティになり、ひょっとすると不自由な思いをしているかもしれない。

せっかく日本に来てくれたのだ、少しでも良い思い出を作ってほしいものだ。

Skypeの同時通訳機能を誰でも使えるようになった

青木 竜太コンセプトデザイナー / 社会彫刻家

記事ではメッセンジャー機能だけが翻訳されるように受け取れるが、リンク先のマイクロソフトのWEBサイトを見ると”Your one-to-one voice or video chats are translated as you speak, in both directions.”とあるので、話している言葉が同時翻訳されるはず。

日本語に関しては、精度的なものはそんなに期待できないだろう。音声認識→翻訳、それぞれでかなりの技術が必要になる。

翻訳技術に関して言えば、乱暴に言えば、難易度レベルはこんな感じになるのではないか。

(LV1)単純に単語を翻訳 → (LV2)言語の文法を理解して翻訳 → (LV3) 話(文章)の文脈も考慮 → (LV4)各専門分野の特有の言い回しを考慮 → (LV5)各国の文化的な背景を考慮 → (LV6)各コミュニティの文化的な背景を考慮(サブカル含む) → (LV7)アート的な表現や文脈を考慮

(LV1)は、いわゆる英和・和英検索のサービス。これはある程度満足いくレベルに到達している。(LV2)は、Google 翻訳が代表格だろう。日本語では、まだ満足いくレベルまで到達していない気がする。テキストが正しい(音声認識による破損のない)データとして収得できるWEBサイトでさえ、意味の通るレベルまで訳せていない。

クラウドソーシング型翻訳サービスで蓄積している(人の手を介して翻訳された)データを活用できれば、ひょっとすると、(LV2) まで多少なりとも近づけることができるかもしれない。

音声認識もまだまだ発展途上で、皆が期待しているほどのものではないと思う。

いずれにしても、どのぐらい先かわからないが、このような技術の発展が、目に見えない言語の壁を取り除き、例えば地方にいるおじいちゃんやおばあちゃんたちが直接日本語で世界で対話している世界が訪れた時、見た目以上に世界は大きく変わっていると思う。

NORMAL

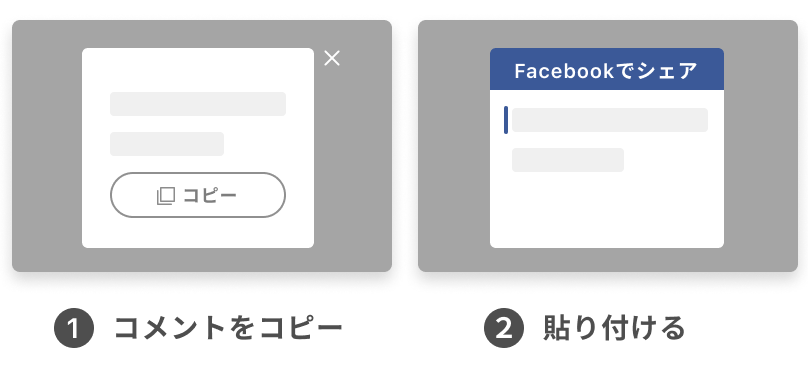

投稿したコメント