「人工知能脅威論」と真摯に向き合う

人工知能(AI)は人類にとって最大の脅威にもなれば、医療の向上を目指す努力の証にもなる。その答えは質問する相手によって変わる。

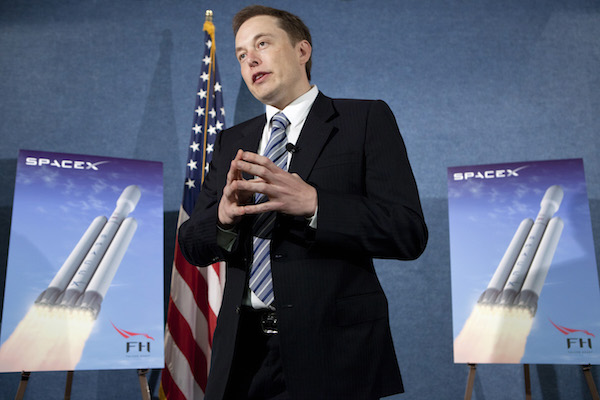

起業家のイーロン・マスクやビル・ゲイツ、宇宙物理学者のスティーブン・ホーキングは、超知的な人工知能が暴走すれば人類の存続を脅かしかねないと警告する。一方で、マイクロソフトの共同創業者のポール・アレンやアリババ創業者の馬雲(ジャック・マー)は、人工知能の強い味方だ。

高まる人工知能批判を受けて、アレンが立ち上げたアレン人工知能協会やスタンフォード大学を中心とする擁護派は、マイナスイメージを変えようとしている。

アレン人工知能協会は、医療の向上を目指すプロジェクトの意義を強調する。スタンフォード大学は倫理問題などについて100年規模の研究を始めた。こうした努力はすべて、人工知能の世界に、周囲で高まる不安と向き合うように促す動きでもある。人工知能の分野は拡大し続けている。ベンチャーキャピタルの投資額は2010年から20倍に増加。スタートアップも次々に誕生している。

「私たちが悪魔を解き放ったと、強烈な言葉で非難する人もいるから、私たちは答えようとしている」と、アレン人工知能協会のオーレン・エツィオーニCEOは言う。「メディアの論調はかなり一方的だ」

不安をあおる滑稽なデマも

世論の関心を集めて不安を和らげようという組織的な努力は、持続的な運動に発展しつつある。

マサチューセッツ工科大学(MIT)の物理学教授で、非営利組織「生命の未来研究所」の共同創立者でもあるマックス・テグマークは、一連の論争で双方の共通の出発点を見出そうとしている。1月初めにプエルトリコで開催された研究所の最初の協議会には、イーロン・マスクも参加した。その席でテグマークは公開書簡を提案し、エツィオーニやマスクなど、擁護派からも反対派からも多くの研究者や論客が署名。1月12日に発表された。

「マッド・マックス」の異名をもつテグマークは次のように語る。「不安をあおる滑稽なデマも、たくさん流れている。人工知能の研究者の多くがひるむのも無理はない」

人工知能に人間の倫理観をどのように植えつけるかという議論が必要なことは、対立する両陣営の「共通認識」だと、人工知能に関する教科書の共著もあるカリフォルニア大学バークレー校のスチュワート・ラッセル教授は言う。ラッセルは、アニメ「宇宙家族ジェットソン」に登場するロージーのような家事手伝いロボットを例に挙げる。

「(ロボットが)おかしなことをしないように、人間の価値観を理解させる必要がある。夕飯に猫の料理を出されたくはない」

最近まで、この類の問題を研究者は基本的に無視してきたと、ラッセルは指摘する。突拍子もない作り話か、遠い先の話だと思われてきたのだ。しかし、世界的に著名な科学者やイノベーターが人工知能に警鐘を鳴らすようになり、研究者の考え方も変わってきた。

「物事の流れが加速して、迅速に対応できるように多くの資本が投じられ、人工知能の世界の雰囲気も変わりつつある」

AI擁護派のメディア対策

1月28日にはビル・ゲイツも議論に参戦。自分も超知的な人工知能に懸念を抱くひとりだと明言した。昨年12月にスティーブン・ホーキングは、人工知能がさらに進化すれば「人類の終焉(しゅうえん)をもたらす可能性がある」と発言。イーロン・マスクは10月に、人工知能は人類の「存続を脅かしかねない。これまで以上に監視する必要がある」と語っている。

マスクは一方で、テグマークの公開書簡が発表された後、生命の未来研究所に1000万ドルを寄付している。同研究所の公式サイトは、「人類が存続を脅かされる危険を軽減する」ために尽力すると述べている。マスクとホーキングは同研究所の科学顧問に名を連ねる。2人とも今回のメール取材に返答はなかった。

最近は研究者もメディア対策に力を入れている。エツィオーニをはじめとする専門家は、学術論文だけでなくニュースサイトなどでコラムも執筆して、人工知能の恩恵をより広い読者層に訴える。エツィオーニは、マイクロソフトの研究部門のトップで米人工知能学会の元会長でもあるエリック・ホロビッツとも協力して、イメージ戦略に努めている。

エツィオーニは、思考する機械の開発が、実用的な形で人類に寄与することを知ってほしいと考えている。アレン人工知能協会は、人工知能の研究を医療の向上に結びつけるプロジェクト「セマンティック・スカラー」に取り組んでいる。

これは、大量の専門誌記事を検索して、メタデータを抽出し、論文や主要な引用の出典を分類して、新しい発見が医療現場で実践されるまでの時間を短縮しようというプロジェクトだ。「必要な論文をより短時間で見つけられるようになれば、がんの治療にも役立つだろう」と、エツィオーニは言う。

科学者としての説明責任

ホロビッツはスタンフォード大学の「100年プロジェクト」に携わっている。プロジェクトでは人工知能の倫理的な難題を研究し、安全保障や心理学、産業の自動化、プライバシーなどの分野で、人工知能がどのように機能するかを検証する。

「一連の懸念を頭ごなしに否定するべきではない」と、ホロビッツは言う。「人工知能の研究者と科学者は、心配する必要がない理由を説明するべきだ」

人工知能を悪魔と見なす動きが加速すると、政府の干渉や研究の制限が強まるかもしれないと、エツィオーニは言う。危険な前例はすでにある。アメリカでは幹細胞の研究をめぐって、ヒトのES細胞(胚性幹細胞)を作成したり破壊したりすることの倫理的な問題が取り沙汰されている最中に、研究を規制する動きが始まった。

「人工知能が研究室から脱走して暴れまわるというのは、ハリウッド映画にはうってつけの筋書きかもしれないが、現実的ではない」と、人工知能の研究を20年以上続けてきたエツィオーニは言う。「機械にちょっとした学習をさせるプログラムを作成するだけでも、かなり苦労する。脱走のように、人々が想像する最悪の事態を学習させる技術は、はるか先の話だ」

とはいえ、人工知能が無法者と化して人間に襲いかかるというイメージは定着している。1818年に発表された小説「フランケンシュタイン」に、1968年の映画「2001年宇宙の旅」で道徳観を見失うHAL9000。2013年の映画「her/世界でひとつの彼女」では、主人公の男性が人工知能型OS(オペレーティング・システム)に恋焦がれる。今春公開される映画「チャッピー」は、考えて感じることのできるロボットの物語だ。

開発をめぐる環境の変化

人工知能の開発は1960年代に始まったが、小学生レベルの人間の知能を模倣できる機械やシステムさえまだ実現していないと、ホロビッツは言う。それでも近年は、企業や公的機関、病院、政府などが膨大な量のデータと格闘するようになり、より効率的に分析できるツールが必要となって、人工知能への楽観的な期待が高まり、資金も増えている。

マイクロソフトでは、スカイプを使ったウェブ経由の通話サービスを、人工知能の開発チームが支えている。音声を自動認識し、翻訳して読み上げ、多言語間の会話を実現しようというのだ。ポール・アレンが巨額の資金を提供しているアレン人工知能協会は、小学生レベルの科学と数学の標準テストの合格を目指して、人工知能を訓練している。

グーグルは昨年1月に、ロンドンを拠点とする人工知能関連のスタートアップ、ディープマインドを4億ドルで買収した。アレンやフェイスブックのマーク・ザッカーバーグCEOも、人工知能の研究プロジェクトに出資している。調査会社CBインサイツによると、人工知能関連のスタートアップへの投資額は、2010年の1490万ドルから昨年2014年は3億920万ドルに急増している。

倫理的問題は避けて通れない

ホロビッツに言わせれば、人類を滅ぼすのは人工知能ではない。人工知能の技術の遅れが、すでに人間の命を奪っているというのだ。人工知能を使えば防げるであろう医療ミスや、改良できるはずの非効率的な治療のせいで、命が失われている。

ただし、ロボットの大群が人類を攻撃するとは思わないが、研究者は今後さらに高まるであろう倫理的な問題に取り組む必要があると、ホロビッツは指摘する。例えば、人工知能に関連する技術を使って選挙で世論を誘導できるかもしれない。

あるいは、ソーシャルメディアの投稿など膨大な量の公開データを使って、ある人がうつかどうかを予想できるようになるかもしれない。ホロビッツは実際にマイクロソフトで、被験者のツイッターの投稿をもとに、産後うつの傾向を調べる研究をしたことがある。倫理的な妥当性の判断方法は、スタンフォードの研究プロジェクトの課題のひとつだ。

「こうした不安は昔から言われてきた」と、ホロビッツは言う。「不安があるなら、私たちは科学者として、理解を得られる成熟した姿勢で向き合わなければならない」

(執筆:Dina Bass and Jack Clark、写真:Bloomberg、翻訳:矢羽野薫)

Copyright 2015 Bloomberg News. All Rights Reserved.

www.bloomberg.co.jp