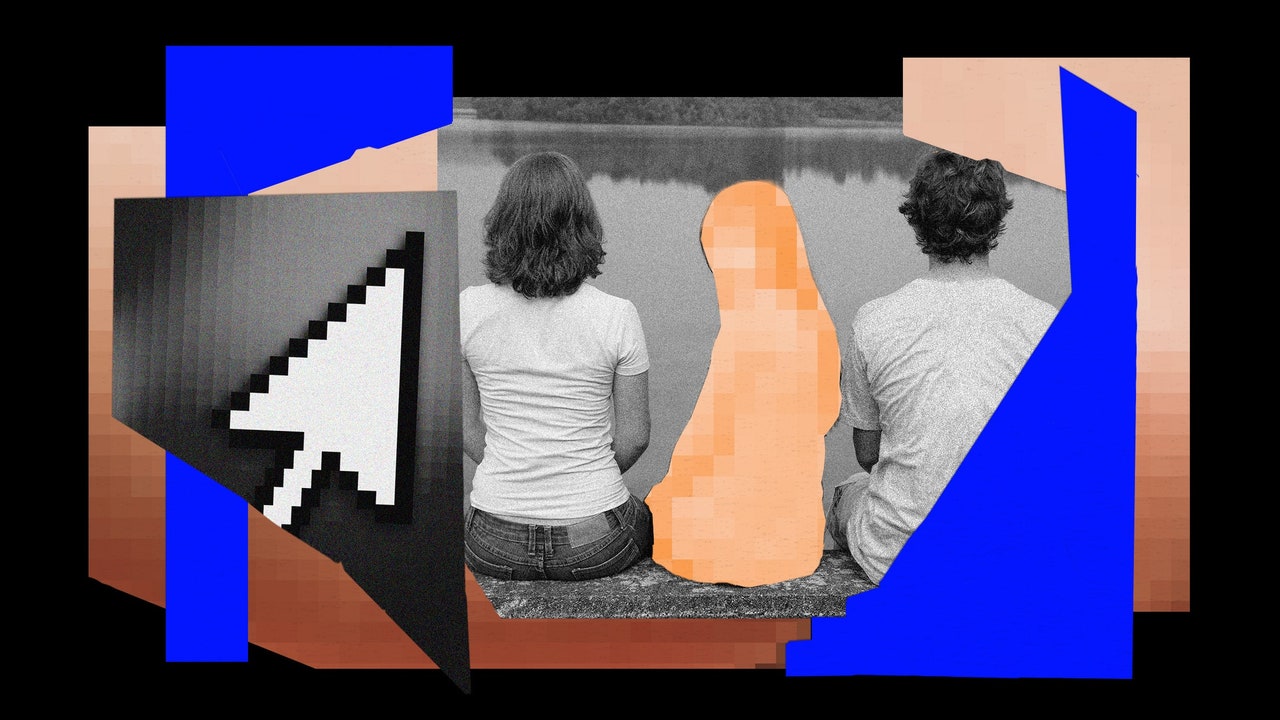

AIで見知らぬ他人の写真を“ヌード化”、ディープヌード生成サイトの衝撃

コメント

注目のコメント

ディープポルノ以前にアイコラは30年前から存在する犯罪です。

日本では名誉毀損罪に当たります。他者の画像なら著作権法違反です。著名人ならパブリシティ権侵害で損害賠償の対象となり得ます。

問題は被害者の訴えが原則なことと、捜査に手間がかかり過ぎることでしょうね。実効性ある抑止策を考える必要がありそうです。AIがなくてもデマに翻弄されるSNSの時代。ディーフフェイクやらで真偽の確認が難しくなったら手におえなくなりそう。芸能人の浮気を捏造したり政治家が暴言を吐いたみたいなことが捏造できてしまう。しかも多くの人は何が正しいかより信じたいものを信じる傾向がある。

法による取り締まりも必要だと思うが簡単に真偽が分からない分だけ、言論の自由とバッティングするだろう。せめて2つ以上の見解があることが分かればいいのだが。そして大人になってからリテラシーを高めてもらうのは難しいと思うのでせめて学校教育であるていどはやってほしい。

エコーチェンバー・フィルターバブル・ポスト・トゥルースといったこと。知っている人は知っているが知らない人は知らないし知ろうともしない。承認欲求の代償としてはあまりに大きな傷を負う事になる。

この手のコラージュは大昔から存在しているが、テクノロジーの進化によって、人間の汚い部分が日増しに表出してきている。