政府がAI法規制を検討 偽情報対策不備なら罰則

コメント

選択しているユーザー

注目のコメント

先日EUによるAIに対しての規制に続いて日本でも。EUでは、生成AIで制作されたコンテンツに対し生成AI作であることを明記し、準じなければ罰則があるという法規制が導入されました。

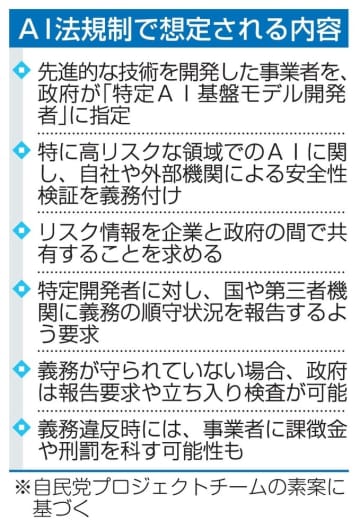

対して日本では、AIに関する技術開発社を「特定AI基盤モデル開発者」に指定し、義務違反があれば課徴金や刑罰を科されることも。

第三者による形骸的な審査にならないか懸念が残ります。悪質な技術提供者や意図しない生成AIの暴走の歯止めになる機関になるといいのですが。「特定AI基盤モデル開発者」の定義が難しそうです。特にファインチューニングをどこまで含めるのか。対象はサービス単位なのか企業単位なのか。

EUのように外形的に利用者数で決めるのは有力な方法と思います。ただし、利用者数だけですとリリース当初は指定から外れるのと、ニッチな危ないAIモデルが対象外となってしまいます。